Бумът упорито подминава един ъгъл на AI технологията

Става по-лесно да се манипулират изображения, но има малък финансов стимул за компаниите да инвестират в инструменти за откриване на фалшификати

Редактор: Даниел Николов

Изкуственият интелект сега е толкова мощен, че може да подмами хората да повярват, че изображение на папа Франциск, облечен в бяло пухкаво палто на Balenciaga, е истинско, но цифровите инструменти за надеждно идентифициране на фалшиви изображения се борят да поддържат темпото на генериране на съдържание.

Просто попитайте изследователите от Училището по информационни технологии на университета "Дийкин" край Мелбърн. Техният алгоритъм се представи най-добре при идентифицирането на променените изображения на знаменитости в набор от така наречените "дийпфейк" (дълбоки фалшификати) миналата година, според индекса на изкуствения интелект на Станфордския университет за 2023 г.

„Това е доста добро представяне“, каза Чанг-Цун Ли, професор в Центъра за киберустойчивост и доверие на "Дийкин", който разработи алгоритъма, който се оказа правилен в 78% от случаите. „Но технологията наистина все още е в процес на разработка.“ Ли каза, че методът трябва да бъде допълнително подобрен, преди да бъде готов за търговска употреба.

Дийпфейк са изображения, които са били дигитално манипулирани, за да заменят един човек убедително с друг.

Те съществуват и предизвикват безпокойство от години. Бившият председател на Камарата на представителите Нанси Пелоси изглежда изрича думите си в подправено видео през 2019 г., което се разпространява широко в социалните медии на Meta Platforms Inc. Около месец по-късно главният изпълнителен директор Марк Зукърбърг беше видян във видео, променено, за да изглежда, че е казал нещо, което не е, след като Facebook по-рано отказа да свали видеоклипа на Пелоси.

Въпреки че образът на папата в пухкаво яке беше сравнително безобидна манипулация, потенциалът за нанасяне на сериозни щети от дълбоки фалшификати, от изборна манипулация до сексуални актове, нарасна с напредването на технологията. Миналата година фалшив видеоклип на президента на Украйна Володимир Зеленски, който моли войниците си да се предадат на Русия, можеше да има сериозни последици.

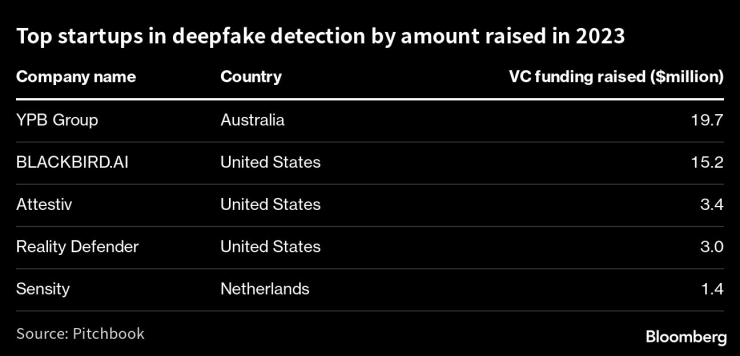

Големи технологични компании, както и вълна от стартиращи фирми, наляха десетки милиарди долари в генеративен AI, за да претендират за водеща роля в технологията, която може да промени лицето на всичко - от търсачките до видеоигрите. Глобалният пазар за технологии за изкореняване на манипулирано съдържание обаче е относително малък. Според изследователската фирма HSRC глобалният пазар за откриване на дълбоки фалшификати е оценен на 3,86 милиарда долара през 2020 г. и се очаква да се разшири с общ годишен темп на растеж от 42% до 2026 г.

Експертите са съгласни, че има прекомерно внимание към генерирането на AI и недостатъчно към откриването, каза Клеър Лейбович, ръководител на Програмата за AI и медиен интегритет в организацията с нестопанска цел The Partnership on AI.

Докато манията около технологията, доминирана от приложения като ChatGPT на OpenAI, достигна връх, ръководителите от главния изпълнителен директор на Tesla Inc. Илън Мъск до главния изпълнителен директор на Alphabet Inc. Сундар Пичай предупредиха за рисковете от твърде бързото развитие.

Ще мине известно време, преди инструментите за откриване да са готови да се използват за борба срещу вълната от реалистично изглеждащи променени изображения от генеративни AI програми като Midjourney, която създаде изображението на папата, и DALL-E на OpenAI. Част от проблема е непосилно високите разходи за разработване на точно откриване и има малък правен или финансов стимул за това.

„Всеки ден говоря с ръководители по сигурността“, каза Джеф Полард, анализатор във Forrester Research. „Те са загрижени за генеративния AI. Но когато става дума за нещо като откриване на фалшификати това не е нещо, за което харчат бюджет. Те имат толкова много други проблеми."

Все пак шепа стартиращи фирми като базираната в Нидерландия Sensity AI и базираната в Естония Sentinel разработват технология за откриване на дийпфийк, както и много от големите технологични компании. Intel Corp. пусна своя продукт FakeCatcher миналия ноември като част от работата си в отговорния AI. Технологията търси автентични улики в реални видеоклипове, като оценява човешките черти като кръвния поток в пикселите на видеото и може да открие фалшификати с 96% точност, според компанията.

„Мотивацията за откриване на дълбоки фалшификати сега не е парите; Това помага за намаляване на онлайн дезинформацията“, каза Илке Демир, старши научен сътрудник в Intel.

Досега стартиращите компании за откриване на дълбоки фалшификати обслужват главно правителства и фирми, които искат да намалят измамите и не са насочени към потребителите. Reality Defender, стартираща компания, поддържана от Y-Combinator, начислява такси въз основа на броя сканирания, които извършва. Тези разходи варират от десетки хиляди долари до милиони, за да покрият скъпите чипове за обработка на графики и мощността на облачните изчисления.

Платформи като Facebook и Twitter не са задължени по закон да откриват и предупреждават за дийпфейк съдържание на своите платформи, оставяйки потребителите на тъмно, каза Бен Колман, главен изпълнителен директор на Reality Defender. „Единствените организации, които правят нещо, са тези като банките, които имат пряка връзка с финансовите измами.“

Това може да се промени, тъй като дийпфейк стават по-сложни и засягат повече хора. AI улесни възпроизвеждането на нечий глас и измамите се увеличават. Престъпниците използват такива инструменти, за да подмамят жертвите да превеждат пари или да одобряват финансови трансфери. А песента „Heart on My Sleeve“, която твърди, че използва AI версии на гласовете на Drake и Weeknd, за да създаде приемливо копие, създаде правни и творчески опасения в музикалната индустрия.

Настоящите методи за откриване на фалшиви изображения и видеоклипове включват сравняване на визуални характеристики в съдържанието чрез обучение на компютри да се учат от примери и вграждане на водни знаци и пръстови отпечатъци от камерата върху оригинални произведения. Но бързото разпространение на дийпфейк изисква по-мощни алгоритми и изчислителни ресурси, каза Шикуан Лу, друг професор от университета "Дийкин", който е работил върху алгоритъма.

И без наличен в търговската мрежа и масово възприет инструмент за разграничаване на фалшиво онлайн съдържание от истинско, има много възможности за злоупотреби

„Това, което виждам, е доста подобно на това, което видях в ранните дни на антивирусната индустрия“, каза Тед Шлейн, председател и генерален партньор в Ballistic Ventures, който инвестира в откриване на дулбоки фалшификати и преди това е инвестирал в антивирусен софтуер в ранните му дни. Тъй като хаковете станаха по-сложни и вредни, антивирусният софтуер се разви и в крайна сметка стана достатъчно евтин, за да го изтеглят потребителите на компютрите си.

„Ние сме в най-началния етап на дийпфейк“, което досега се прави предимно за развлекателни цели. „Сега едва започвате да виждате някои от злонамерените случаи“, каза Шлейн.

Но дори и да е достатъчно евтино, потребителите може да не са склонни да плащат за такава технология, каза Шуман Госемаджумдер, бивш ръководител на изкуствения интелект във F5 Inc., компания за сигурност и предотвратяване на измами.

„Потребителите не искат сами да вършат допълнителна работа“, каза той. „Те искат автоматично да бъдат защитени, доколкото е възможно.“